Introducción

Hace unos meses, dediqué una entrada a cómo crear diseños experimentales para MaxDiff y ya se mencionó entonces el análisis conjunto como una técnica que en muchos caso se presentaba como similar. Por motivos que no vienen al caso, ha surgido la necesidad de trabajar con esta técnica, y me he puesto manos a la obra con R.

El análisis conjunto es un método de marketing que permite conocer las expectativas de los consumidores sobre un producto y modelar sus elecciones. El método de análisis conjunto es en la actualidad extremadamente común en el análisis de mercados ya que como bien sabemos, la modelización de la elección del consumidor es un área determinante en el marketing moderno. Se utiliza cuando una marca quiere saber cuán importantes son los diferentes elementos de una decisión.

Sabemos por neurociencia que las personas (personas como usted y yo) no pueden poner valores numéricos a lo importante que es, por ejemplo, volar directamente versus volar en su aerolínea preferida. Pero las marcas necesitan valores numéricos cuando buscan maximizar los ingresos, las ganancias, la elección del cliente y la satisfacción. De este modo, el análisis conjunto se utiliza para simular mercados competitivos utilizando un único análisis; esa es su mayor ventaja. Disponemos de dos métodos de análisis conjunto: el análisis conjunto de perfil completo y el análisis conjunto basado en elecciones CBC (Choice Based Conjoint). En esta entrada, nos dedicaremos al análisis conjunto de perfil completo.

Tras estudiar diferentes alternativas, muchas referencias me llevaron al paquete ‘Conjoint’ de Andrzej Bak and Tomasz Bartlomowicz. Como siempre, utilizando una de las bases de datos de ejemplo, la referente al estudio de té, muestra de 100 casos de valoración de perfiles en estudio conducido por M. Baran en 2007, trabajé con ello para ver su sencillez.

Diseño del experimento

En este tutorial vamos a ver un caso clásico de análisis conjunto sobre la introducción de un nuevo producto en un mercado concurrencial. Este producto es una bebida a base de té. Una marca de refrescos quiere introducir un nuevo producto y se aplica un análisis conjunto con el fin de responder a dos preguntas: ¿Cuáles son las características que debe tener la bebida con el fin de, en primer lugar, satisfacer al mayor número de personas y, en segundo lugar, ganar cuotas de mercado en un mercado ya competitivo?

El primer paso es ajeno al análisis conjunto y requiere de la experiencia de nuestro cliente. Consiste en la elección de las características importantes para definir una bebida. Los factores seleccionados son precio, variedad de té, formato y si es o no aromatizado. A partir de estos factores, se pueden obtener 54 productos diferentes. Los jueces no podrán evaluar todos estos productos. Así que vamos a utilizar diseños experimentales para reducir el número de productos presentados a los encuestados.

Los perfiles obtenidos serán clasificados mediante una entrevista a 100 personas.

Utilizando la función del paquete conjoint caFactorialDesign mostramos el diseño del experimento que hemos trabajado con estos factores y sus atributos, hemos diseñado las siguientes 54 combinaciones posibles.

- Productos de té

- precio

- bajo

- medio

- alto

- variedad

- negro

- verde

- rojo

- formato

- bolsa

- en grano

- en hoja

- aromatizado

- sí

- no

- precio

Como es lógico, no podemos trabajar con estas 54 combinaciones, dado que ello cansaría al entrevistado sobremanera. Así que deberemos reducir el experimento al mínimo necesario para obtener una buena representación de los perfiles y poder determinar las utilidades de cada nivel y factor. Nuestro experimento se realizará mostrando tarjetas al entrevistado para que valore de 0 a 10, cada uno de los perfiles seleccionados.

Perfiles analizados en la investigación. Rating de 0 a 10.

Del conjunto de los 54 perfiles posibles, fueron elegidos para testar 13 (uso de diseño factorial de experimentos)

Perfiles seleccionados:

Estos 13 perfiles han sido preguntados de forma aleatoria en un cuestionario autoadministrado online y se han obtenido 100 respuestas a los 13 perfiles testados.

Carga de datos

Mostramos un extracto (10 casos) de la tabla de datos, para el diseño experimental analizado.

Tabla de datos:

Parámetros del modelo

El primer resultado que podemos abordar nos muestra el modelo y los parámetros que en él se obtienen. En este caso lo hacemos con el individuo nº 1, es decir con la primera observación de nuestra tabla de datos.

Call:

lm(formula = frml)

Residuals:

1 2 3 4 5 6 7 8 9 10 11 12 13

1.1345 -1.4897 0.3103 -0.2655 0.3103 0.1931 1.5931 -1.4310 -1.4310 1.1207 0.3690 1.1931 -1.6069

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 3.3937 0.5439 6.240 0.00155 **

factor(x$price)1 -1.5172 0.7944 -1.910 0.11440

factor(x$price)2 -1.1414 0.6889 -1.657 0.15844

factor(x$variety)1 -0.4747 0.6889 -0.689 0.52141

factor(x$variety)2 -0.6747 0.6889 -0.979 0.37234

factor(x$kind)1 0.6586 0.6889 0.956 0.38293

factor(x$kind)2 -1.5172 0.7944 -1.910 0.11440

factor(x$aroma)1 0.6293 0.5093 1.236 0.27150

---

Signif. codes: 0 '***' 0.001 '**' 0.01 '*' 0.05 '.' 0.1 ' ' 1

Residual standard error: 1.78 on 5 degrees of freedom

Multiple R-squared: 0.8184, Adjusted R-squared: 0.5642

F-statistic: 3.22 on 7 and 5 DF, p-value: 0.1082Pero los resultados más importantes son las utilidades parciales (partial utilities), así como las importancias individuales (individual importances). Se pueden encontrar en las primeras tablas. Vemos que las utilidades (utilities) son individuales, así como la importancia (importance). Veamos estos resultados.

Importancia de cada uno de los atributos

Recordemos que nuestros atributos o factores eran:

- precio

- variedad

- formato

- aromatizado

Resumen de importancias:

[1] 24.76 32.22 27.15 15.88[1] Suma: 100.01Utilidades

De los individuos (100 respondentes)

Así com anterioremnte usamos la función caModel para obtener los parámetros del modelo de regresión que se usa para el conjoint analysis, ahora podemos observar que esta tabla que mostramos a continuación, denominada de utilidades parciales nos muestra la misma información pero para todos y cada uno de los respondentes en la muestra. Nótese como la fila 1 coincide con la tabla de parámetros vista anteriormente.

Utilidades parciales de los individuos:

intercept low medium high black green red bags granulated leafy yes no

[1,] 3.394 -1.517 -1.141 2.659 -0.475 -0.675 1.149 0.659 -1.517 0.859 0.629 -0.629

[2,] 5.049 3.391 -0.695 -2.695 -1.029 0.971 0.057 1.105 -0.609 -0.495 -0.681 0.681

[3,] 4.029 2.563 -1.182 -1.382 -0.248 2.352 -2.103 -0.382 -2.437 2.818 0.776 -0.776

[4,] 5.856 -1.149 -0.025 1.175 -0.492 1.308 -0.816 -0.825 -0.149 0.975 0.121 -0.121

[5,] 6.250 -2.333 2.567 -0.233 -0.033 -0.633 0.667 -0.233 -0.333 0.567 -1.250 1.250

[6,] 1.578 -0.713 -0.144 0.856 1.456 -0.744 -0.713 0.656 -0.713 0.056 1.595 -1.595

[7,] 2.635 -0.920 -1.040 1.960 -0.707 0.293 0.414 -1.107 -2.586 3.693 0.147 -0.147

[8,] 4.405 -0.425 0.413 0.013 0.546 -2.454 1.908 1.479 0.241 -1.721 -1.060 1.060

[9,] 3.546 -0.966 0.883 0.083 2.216 1.416 -3.632 -0.917 -0.966 1.883 -0.259 0.259

[10,] 5.460 0.678 -0.639 -0.039 0.228 0.428 -0.655 -1.172 -2.655 3.828 1.414 -1.414

[11,] 5.626 0.678 -0.239 -0.439 0.228 0.428 -0.655 -1.439 -2.322 3.761 0.914 -0.914

[12,] 5.566 0.862 -0.631 -0.231 0.502 0.302 -0.805 -0.898 -2.805 3.702 1.284 -1.284

[13,] 1.319 0.552 0.424 -0.976 0.691 -0.909 0.218 -0.243 -1.115 1.357 -0.388 0.388

[14,] 1.925 -0.264 -0.568 0.832 1.499 -1.901 0.402 0.099 -0.598 0.499 0.983 -0.983

[15,] 1.776 -0.793 -0.103 0.897 3.697 -1.903 -1.793 1.097 0.207 -1.303 -0.052 0.052

[16,] 2.296 -0.632 -0.284 0.916 3.383 -1.417 -1.966 0.983 0.034 -1.017 -0.009 0.009

[17,] 4.506 1.379 0.510 -1.890 -1.090 -0.290 1.379 0.377 0.046 -0.423 -0.345 0.345

[18,] 1.075 -0.402 -0.699 1.101 0.968 -0.232 -0.736 1.101 -0.402 -0.699 1.017 -1.017

[19,] 3.486 -1.115 0.757 0.357 -0.976 2.424 -1.448 -0.376 0.552 -0.176 0.112 -0.112

[20,] 1.736 0.218 -0.609 0.391 3.124 -1.676 -1.448 0.591 -0.782 0.191 0.862 -0.862

[21,] 2.236 0.885 -1.343 0.457 -0.143 1.257 -1.115 1.591 -1.782 0.191 1.362 -1.362

[22,] 4.874 1.655 -1.628 -0.028 0.506 0.506 -1.011 0.772 -2.345 1.572 1.586 -1.586

[23,] 0.256 0.379 0.010 -0.390 0.544 -0.256 -0.287 -0.056 -0.287 0.344 -0.095 0.095

[24,] 3.664 -1.690 0.245 1.445 -3.622 0.978 2.644 -0.289 -2.023 2.311 -1.078 1.078

[25,] 3.006 1.713 -0.156 -1.556 -0.623 3.577 -2.954 0.177 -0.954 0.777 0.155 -0.155

[26,] 3.394 -1.517 -1.141 2.659 -0.475 -0.675 1.149 0.659 -1.517 0.859 0.629 -0.629

[27,] 5.049 3.391 -0.695 -2.695 -1.029 0.971 0.057 1.105 -0.609 -0.495 -0.681 0.681

[28,] 2.239 1.575 0.013 -1.587 -1.454 3.546 -2.092 0.346 -1.092 0.746 0.440 -0.440

[29,] 5.856 -1.149 -0.025 1.175 -0.492 1.308 -0.816 -0.825 -0.149 0.975 0.121 -0.121

[30,] 6.250 -2.333 2.567 -0.233 -0.033 -0.633 0.667 -0.233 -0.333 0.567 -1.250 1.250

[31,] 1.578 -0.713 -0.144 0.856 1.456 -0.744 -0.713 0.656 -0.713 0.056 1.595 -1.595

[32,] 2.635 -0.920 -1.040 1.960 -0.707 0.293 0.414 -1.107 -2.586 3.693 0.147 -0.147

[33,] 4.405 -0.425 0.413 0.013 0.546 -2.454 1.908 1.479 0.241 -1.721 -1.060 1.060

[34,] 3.546 -0.966 0.883 0.083 2.216 1.416 -3.632 -0.917 -0.966 1.883 -0.259 0.259

[35,] 5.388 1.103 -0.652 -0.452 0.548 0.348 -0.897 -1.252 -2.897 4.148 1.474 -1.474

[36,] 5.810 0.483 -0.441 -0.041 0.559 -0.041 -0.517 -1.041 -2.517 3.559 0.879 -0.879

[37,] 5.681 0.782 -0.491 -0.291 0.443 0.443 -0.885 -1.224 -2.552 3.776 1.388 -1.388

[38,] 1.572 0.575 0.613 -1.187 0.879 -1.121 0.241 -0.321 -0.759 1.079 -0.560 0.560

[39,] 1.925 -0.264 -0.568 0.832 1.499 -1.901 0.402 0.099 -0.598 0.499 0.983 -0.983

[40,] 1.621 -0.701 -0.349 1.051 3.451 -1.749 -1.701 1.251 0.299 -1.549 -0.241 0.241

[41,] 2.365 -0.747 -0.226 0.974 2.907 -1.493 -1.414 1.174 0.253 -1.426 -0.147 0.147

[42,] 4.506 1.379 0.510 -1.890 -1.090 -0.290 1.379 0.377 0.046 -0.423 -0.345 0.345

[43,] 1.822 1.241 -1.021 -0.221 2.779 -1.021 -1.759 1.313 -1.425 0.113 0.190 -0.190

[44,] 3.486 -1.115 0.757 0.357 -0.976 2.424 -1.448 -0.376 0.552 -0.176 0.112 -0.112

[45,] 2.112 0.563 -0.482 -0.082 3.185 -1.415 -1.770 0.852 -1.103 0.252 1.026 -1.026

[46,] 3.931 0.782 -0.991 0.209 0.276 0.276 -0.552 0.543 -1.885 1.343 2.138 -2.138

[47,] 4.874 1.655 -1.628 -0.028 0.506 0.506 -1.011 0.772 -2.345 1.572 1.586 -1.586

[48,] 2.417 1.333 0.833 -2.167 3.967 -1.633 -2.333 0.433 -1.667 1.233 0.250 -0.250

[49,] 3.420 -1.310 1.255 0.055 0.455 -1.145 0.690 -0.478 0.356 0.122 2.328 -2.328

[50,] 2.210 0.345 0.328 -0.672 0.461 -0.139 -0.322 -0.272 -0.655 0.928 0.664 -0.664

[51,] 2.437 0.161 0.320 -0.480 0.253 0.253 -0.506 -1.547 -1.506 3.053 -0.207 0.207

[52,] 2.948 -0.414 -0.193 0.607 1.674 -1.926 0.253 0.340 -0.080 -0.260 0.603 -0.603

[53,] 3.224 1.793 -1.097 -0.697 1.370 1.170 -2.540 1.637 -0.874 -0.763 2.052 -2.052

[54,] 2.721 -0.230 0.215 0.015 1.682 -1.118 -0.563 0.615 -0.230 -0.385 0.474 -0.474

[55,] 4.520 -0.506 0.753 -0.247 0.020 -0.180 0.161 -0.780 -0.839 1.620 0.043 -0.043

[56,] 3.534 1.943 -0.071 -1.871 0.662 1.062 -1.724 -1.005 -1.391 2.395 -0.569 0.569

[57,] 2.598 0.782 0.409 -1.191 1.476 -0.924 -0.552 0.876 -1.552 0.676 1.138 -1.138

[58,] 5.250 0.000 -0.500 0.500 2.167 2.167 -4.333 -0.967 1.333 -0.367 -0.250 0.250

[59,] 3.652 -0.782 -0.109 0.891 -0.576 0.024 0.552 0.424 -0.448 0.024 1.612 -1.612

[60,] 4.052 1.747 -0.874 -0.874 -3.340 2.260 1.080 0.593 -0.586 -0.007 0.397 -0.397

[61,] 3.109 2.207 -1.103 -1.103 1.030 1.430 -2.460 1.630 -1.460 -0.170 0.948 -0.948

[62,] 2.336 0.690 0.155 -0.845 0.422 1.222 -1.644 0.489 0.023 -0.511 1.078 -1.078

[63,] 3.046 -0.966 0.483 0.483 -0.584 0.216 0.368 -1.117 -0.966 2.083 0.241 -0.241

[64,] 4.118 0.276 -0.438 0.162 -1.305 0.695 0.609 0.295 -0.391 0.095 1.181 -1.181

[65,] 4.833 1.000 0.200 -1.200 0.800 0.200 -1.000 0.867 -0.333 -0.533 1.500 -1.500

[66,] 3.103 0.161 0.320 -0.480 0.253 0.253 -0.506 -1.214 -1.172 2.386 -0.207 0.207

[67,] 2.983 -0.471 -0.264 0.736 1.602 -1.798 0.195 0.269 -0.138 -0.131 0.534 -0.534

[68,] 3.451 1.276 -0.838 -0.438 1.495 0.895 -2.391 1.562 -0.724 -0.838 2.181 -2.181

[69,] 3.055 -0.230 0.215 0.015 2.348 -1.452 -0.897 0.615 -0.230 -0.385 0.474 -0.474

[70,] 4.520 -0.506 0.753 -0.247 0.020 -0.180 0.161 -0.780 -0.839 1.620 0.043 -0.043

[71,] 4.428 1.759 -0.079 -1.679 0.587 0.987 -1.575 -0.879 -1.241 2.121 -0.440 0.440

[72,] 1.759 0.069 0.366 -0.434 2.899 -1.301 -1.598 -0.368 -0.264 0.632 0.483 -0.483

[73,] 3.394 -1.517 -1.141 2.659 -0.475 -0.675 1.149 0.659 -1.517 0.859 0.629 -0.629

[74,] 5.049 3.391 -0.695 -2.695 -1.029 0.971 0.057 1.105 -0.609 -0.495 -0.681 0.681

[75,] 4.029 2.563 -1.182 -1.382 -0.248 2.352 -2.103 -0.382 -2.437 2.818 0.776 -0.776

[76,] 5.856 -1.149 -0.025 1.175 -0.492 1.308 -0.816 -0.825 -0.149 0.975 0.121 -0.121

[77,] 6.250 -2.333 2.567 -0.233 -0.033 -0.633 0.667 -0.233 -0.333 0.567 -1.250 1.250

[78,] 1.578 -0.713 -0.144 0.856 1.456 -0.744 -0.713 0.656 -0.713 0.056 1.595 -1.595

[79,] 3.302 -0.920 -0.840 1.760 -0.707 0.293 0.414 -0.974 -2.253 3.226 0.147 -0.147

[80,] 3.394 -1.517 -1.141 2.659 -0.475 -0.675 1.149 0.659 -1.517 0.859 0.629 -0.629

[81,] 5.049 3.391 -0.695 -2.695 -1.029 0.971 0.057 1.105 -0.609 -0.495 -0.681 0.681

[82,] 3.089 1.379 0.010 -1.390 -1.323 3.277 -1.954 0.277 -0.954 0.677 0.405 -0.405

[83,] 5.856 -1.149 -0.025 1.175 -0.492 1.308 -0.816 -0.825 -0.149 0.975 0.121 -0.121

[84,] 5.388 1.103 -0.652 -0.452 0.548 0.348 -0.897 -1.252 -2.897 4.148 1.474 -1.474

[85,] 1.572 0.575 0.613 -1.187 0.879 -1.121 0.241 -0.321 -0.759 1.079 -0.560 0.560

[86,] 1.925 -0.264 -0.568 0.832 1.499 -1.901 0.402 0.099 -0.598 0.499 0.983 -0.983

[87,] 3.261 -0.241 -0.479 0.721 2.921 -1.679 -1.241 1.254 0.092 -1.346 0.060 -0.060

[88,] 2.365 -0.747 -0.226 0.974 2.907 -1.493 -1.414 1.174 0.253 -1.426 -0.147 0.147

[89,] 4.506 1.379 0.510 -1.890 -1.090 -0.290 1.379 0.377 0.046 -0.423 -0.345 0.345

[90,] 2.411 1.287 -0.944 -0.344 2.456 -0.744 -1.713 1.323 -1.046 -0.277 0.095 -0.095

[91,] 5.437 1.494 0.453 -1.947 -0.947 -0.547 1.494 0.520 0.161 -0.680 -0.207 0.207

[92,] 2.135 -0.586 0.293 0.293 1.426 -0.174 -1.253 0.626 -0.253 -0.374 1.647 -1.647

[93,] 3.486 -1.115 0.757 0.357 -0.976 2.424 -1.448 -0.376 0.552 -0.176 0.112 -0.112

[94,] 2.701 0.609 -0.205 -0.405 3.195 -0.805 -2.391 0.329 -0.057 -0.271 0.931 -0.931

[95,] 2.236 0.885 -1.343 0.457 -0.143 1.257 -1.115 1.591 -1.782 0.191 1.362 -1.362

[96,] 4.641 1.793 -1.397 -0.397 0.537 0.337 -0.874 0.203 -2.207 2.003 1.302 -1.302

[97,] 2.853 1.161 0.220 -1.380 4.620 -1.780 -2.839 0.020 -0.839 0.820 0.043 -0.043

[98,] 4.626 0.011 0.494 -0.506 0.561 -2.239 1.678 1.494 0.011 -1.506 -1.086 1.086

[99,] 3.767 -0.529 0.564 -0.036 2.231 1.631 -3.862 -0.702 -1.195 1.898 -0.284 0.284

[100,] 5.868 0.943 -0.671 -0.271 0.729 0.329 -1.057 -1.205 -2.391 3.595 1.431 -1.431De los perfiles (13 perfiles)

Del mismo modo que hemos calculado las utilidades para los individuos, lo podemos hacer para los perfiles, por lo que en esta tabla, observamos como resultado las utilidades de los 13 perfiles que han sido testados en la investigación. Recordemos que cada perfil era una combinación de precio, variedad, formato y aromatización.

Utilidades totales de los perfiles:

[,1] [,2] [,3] [,4] [,5] [,6] [,7] [,8] [,9] [,10] [,11] [,12] [,13]

[1,] 6.866 2.490 0.690 3.266 8.690 1.807 5.407 3.431 3.431 0.879 1.631 1.807 5.607

[2,] 1.748 9.834 4.034 2.148 1.234 5.110 5.110 6.197 1.397 8.569 7.597 5.510 3.510

[3,] 2.793 9.338 3.538 6.193 4.138 1.441 3.841 -0.414 -0.814 1.276 8.386 7.241 7.041

[4,] 5.834 5.310 7.110 6.434 7.310 4.393 7.393 4.069 6.269 3.621 5.069 7.993 9.193

[5,] 4.500 1.800 6.600 8.100 6.000 9.800 6.400 10.500 6.900 5.500 5.700 10.000 7.200

[6,] 6.141 2.372 1.572 4.541 3.372 1.952 0.752 -0.217 1.583 -2.155 0.783 -0.848 0.152

[7,] 2.928 1.048 -0.552 4.728 8.848 -0.366 3.634 0.755 1.155 -0.603 4.555 5.434 8.434

[8,] 5.383 1.945 1.545 2.583 3.545 7.903 4.503 9.266 6.266 7.190 3.866 1.703 1.303

[9,] 4.669 2.821 4.621 8.269 1.621 5.986 4.386 0.138 5.138 -1.759 6.938 7.986 7.186

[10,] 5.890 6.807 4.007 10.290 10.007 2.462 3.262 1.579 1.579 1.414 8.779 7.662 8.262

[11,] 4.890 6.207 4.407 10.290 9.207 3.262 3.262 2.379 2.179 2.414 9.379 8.662 8.462

[12,] 6.224 7.117 3.717 10.424 9.517 3.255 3.455 1.948 1.748 1.534 9.348 7.655 8.055

[13,] 0.403 0.331 -0.669 3.403 1.531 2.579 -0.421 2.107 0.307 1.362 4.307 2.579 1.179

[14,] 5.338 0.841 -0.159 4.338 4.641 1.972 -0.028 0.876 2.676 0.483 2.676 -1.028 0.372

[15,] 7.414 0.124 -0.076 4.014 -0.476 6.517 1.917 1.028 6.628 -0.552 3.428 -1.483 -0.483

[16,] 7.569 1.221 0.621 4.369 0.221 6.386 2.786 1.038 6.638 -0.259 4.038 -0.414 0.786

[17,] 1.559 5.628 4.428 3.159 3.228 4.648 3.048 7.117 1.917 7.655 4.717 4.648 2.248

[18,] 5.262 2.559 0.759 1.662 1.759 1.428 2.028 -0.276 1.724 -1.483 -0.076 -1.572 0.228

[19,] 2.603 4.531 7.331 3.203 2.331 2.779 5.779 2.307 3.307 1.362 1.107 6.379 5.979

[20,] 6.703 1.731 -0.469 5.303 1.731 3.979 0.179 -0.593 3.607 -1.138 4.407 -1.221 -0.221

[21,] 5.503 7.331 1.731 2.303 3.131 0.979 4.179 0.007 -0.593 -1.138 1.807 0.979 2.779

[22,] 7.710 9.393 2.993 6.910 6.993 2.938 4.538 1.421 1.421 1.586 7.021 3.738 5.338

[23,] 0.259 0.228 -0.372 1.059 -0.172 0.848 -0.352 0.017 0.217 0.155 1.617 0.448 0.048

[24,] 0.121 1.586 1.786 1.521 8.986 1.076 6.876 7.341 0.541 3.672 1.741 8.276 9.476

[25,] 1.159 8.628 5.628 3.159 -0.572 2.248 5.048 -0.083 -0.283 0.655 4.717 7.048 5.648

[26,] 6.866 2.490 0.690 3.266 8.690 1.807 5.407 3.431 3.431 0.879 1.631 1.807 5.607

[27,] 1.748 9.834 4.034 2.148 1.234 5.110 5.110 6.197 1.397 8.569 7.597 5.510 3.510

[28,] -0.017 8.145 5.145 1.983 -0.255 0.703 4.103 0.066 -2.334 0.190 2.666 6.103 4.503

[29,] 5.834 5.310 7.110 6.434 7.310 4.393 7.393 4.069 6.269 3.621 5.069 7.993 9.193

[30,] 4.500 1.800 6.600 8.100 6.000 9.800 6.400 10.500 6.900 5.500 5.700 10.000 7.200

[31,] 6.141 2.372 1.572 4.541 3.372 1.952 0.752 -0.217 1.583 -2.155 0.783 -0.848 0.152

[32,] 2.928 1.048 -0.552 4.728 8.848 -0.366 3.634 0.755 1.155 -0.603 4.555 5.434 8.434

[33,] 5.383 1.945 1.545 2.583 3.545 7.903 4.503 9.266 6.266 7.190 3.866 1.703 1.303

[34,] 4.669 2.821 4.621 8.269 1.621 5.986 4.386 0.138 5.138 -1.759 6.938 7.986 7.186

[35,] 5.707 7.062 3.662 10.907 9.662 2.559 2.559 1.114 1.114 1.224 9.714 7.759 7.959

[36,] 6.166 6.090 3.690 10.366 9.690 4.007 3.807 2.931 2.931 2.379 9.531 8.007 8.407

[37,] 5.997 7.069 4.469 10.797 9.669 3.021 3.221 1.693 1.893 1.638 9.293 8.021 8.221

[38,] 0.383 0.145 -0.255 3.583 1.145 3.303 -0.497 2.666 1.066 2.190 4.666 2.703 0.903

[39,] 5.338 0.841 -0.159 4.338 4.641 1.972 -0.028 0.876 2.676 0.483 2.676 -1.028 0.372

[40,] 7.131 0.179 -0.421 2.931 -0.821 6.214 2.414 1.062 6.662 -0.241 3.062 -1.786 -0.386

[41,] 7.272 1.152 0.752 3.472 0.352 6.366 3.166 2.045 6.645 0.603 3.245 -0.634 0.566

[42,] 1.559 5.628 4.428 3.159 3.228 4.648 3.048 7.117 1.917 7.655 4.717 4.648 2.248

[43,] 5.883 3.545 -1.455 3.883 0.145 4.703 1.703 0.166 2.766 -0.310 5.766 -0.297 0.503

[44,] 2.603 4.531 7.331 3.203 2.331 2.779 5.779 2.307 3.307 1.362 1.107 6.379 5.979

[45,] 7.093 3.138 0.138 6.093 1.538 4.641 0.441 -0.314 3.086 -1.224 5.086 -0.559 -0.159

[46,] 7.097 7.669 3.469 6.697 7.069 1.621 2.821 0.793 0.393 0.138 4.193 2.421 3.621

[47,] 7.710 9.393 2.993 6.910 6.993 2.938 4.538 1.421 1.421 1.586 7.021 3.738 5.338

[48,] 4.900 2.800 0.200 8.700 -0.600 7.400 -1.200 1.100 2.300 -0.500 8.700 2.600 -0.400

[49,] 5.779 2.814 6.214 7.579 6.614 2.324 -0.476 2.559 1.959 0.828 0.359 1.324 0.124

[50,] 2.390 2.807 2.407 4.590 2.807 2.062 0.462 1.279 0.679 0.914 3.279 2.662 1.662

[51,] 0.455 1.097 1.297 5.855 4.297 1.669 0.869 0.910 0.910 0.793 6.110 6.269 5.469

[52,] 6.172 1.552 1.352 4.772 4.152 4.166 1.366 2.745 4.545 2.103 3.345 -0.034 0.766

[53,] 7.586 9.876 4.476 4.786 1.276 3.083 3.283 -0.828 0.972 -0.448 3.572 0.483 0.883

[54,] 5.507 2.462 2.062 4.707 2.262 4.759 1.759 2.514 3.714 1.224 3.314 0.959 0.759

[55,] 3.555 3.097 4.297 6.955 6.097 4.469 3.269 4.610 3.410 3.293 5.610 6.669 5.669

[56,] 0.752 4.966 2.566 5.952 1.766 3.690 2.290 1.303 1.503 2.931 9.103 7.490 5.690

[57,] 4.897 4.469 1.669 6.297 2.669 4.221 0.221 2.193 0.193 0.138 4.393 1.621 0.021

[58,] 6.700 6.200 8.000 6.300 0.800 6.200 7.200 -0.300 9.500 2.500 7.300 6.800 7.800

[59,] 6.003 4.931 4.731 4.603 6.731 1.779 3.379 2.907 1.907 1.362 0.707 1.979 2.979

[60,] 0.828 9.048 5.248 0.228 4.648 0.034 5.634 4.455 -1.145 5.897 2.055 5.034 5.034

[61,] 5.614 9.324 2.924 3.814 0.324 3.717 4.117 0.228 0.628 0.448 5.228 2.317 2.317

[62,] 3.479 5.814 4.814 3.479 0.414 2.324 2.124 0.259 0.859 0.328 1.859 2.124 1.124

[63,] 2.069 1.421 3.021 5.269 6.221 1.586 2.386 2.538 1.738 1.241 3.338 5.586 5.586

[64,] 4.452 6.566 5.166 3.652 6.166 1.490 4.090 3.403 1.403 3.431 2.003 3.290 3.890

[65,] 6.800 8.400 6.400 6.800 3.600 5.200 3.200 3.400 2.600 3.000 4.600 3.200 1.800

[66,] 1.455 2.097 2.297 5.855 4.297 2.669 1.869 1.910 1.910 1.793 6.110 6.269 5.469

[67,] 6.124 1.517 1.317 4.724 4.317 4.055 1.655 2.648 4.648 2.034 3.448 0.255 1.255

[68,] 8.252 9.366 4.966 5.452 1.966 3.490 3.290 -0.397 1.603 -0.569 3.203 0.490 0.890

[69,] 6.507 2.462 2.062 5.707 2.262 5.759 1.759 2.514 4.714 1.224 4.314 0.959 0.759

[70,] 3.555 3.097 4.297 6.955 6.097 4.469 3.269 4.610 3.410 3.293 5.610 6.669 5.669

[71,] 2.017 5.855 3.655 6.617 2.855 4.497 3.297 2.334 2.534 3.810 9.334 7.897 6.297

[72,] 4.338 0.641 1.041 6.138 0.841 4.172 -0.828 -0.324 3.476 -0.517 4.876 0.972 0.172

[73,] 6.866 2.490 0.690 3.266 8.690 1.807 5.407 3.431 3.431 0.879 1.631 1.807 5.607

[74,] 1.748 9.834 4.034 2.148 1.234 5.110 5.110 6.197 1.397 8.569 7.597 5.510 3.510

[75,] 2.793 9.338 3.538 6.193 4.138 1.441 3.841 -0.414 -0.814 1.276 8.386 7.241 7.041

[76,] 5.834 5.310 7.110 6.434 7.310 4.393 7.393 4.069 6.269 3.621 5.069 7.993 9.193

[77,] 4.500 1.800 6.600 8.100 6.000 9.800 6.400 10.500 6.900 5.500 5.700 10.000 7.200

[78,] 6.141 2.372 1.572 4.541 3.372 1.952 0.752 -0.217 1.583 -2.155 0.783 -0.848 0.152

[79,] 3.528 1.848 0.648 5.128 8.848 0.634 4.234 1.755 1.955 0.397 4.755 5.834 8.434

[80,] 6.866 2.490 0.690 3.266 8.690 1.807 5.407 3.431 3.431 0.879 1.631 1.807 5.607

[81,] 1.748 9.834 4.034 2.148 1.234 5.110 5.110 6.197 1.397 8.569 7.597 5.510 3.510

[82,] 1.059 8.428 5.828 2.859 0.828 1.648 4.848 1.017 -0.983 1.155 3.417 6.648 5.248

[83,] 5.834 5.310 7.110 6.434 7.310 4.393 7.393 4.069 6.269 3.621 5.069 7.993 9.193

[84,] 5.707 7.062 3.662 10.907 9.662 2.559 2.559 1.114 1.114 1.224 9.714 7.759 7.959

[85,] 0.383 0.145 -0.255 3.583 1.145 3.303 -0.497 2.666 1.066 2.190 4.666 2.703 0.903

[86,] 5.338 0.841 -0.159 4.338 4.641 1.972 -0.028 0.876 2.676 0.483 2.676 -1.028 0.372

[87,] 8.217 2.655 1.255 4.417 1.455 6.897 3.497 2.734 6.934 1.810 4.534 -0.303 0.897

[88,] 7.272 1.152 0.752 3.472 0.352 6.366 3.166 2.045 6.645 0.603 3.245 -0.634 0.566

[89,] 1.559 5.628 4.428 3.159 3.228 4.648 3.048 7.117 1.917 7.655 4.717 4.648 2.248

[90,] 5.941 4.372 -0.228 3.741 0.172 5.152 2.552 0.983 3.383 0.845 5.783 0.352 0.952

[91,] 2.855 6.697 5.297 4.055 4.097 5.669 3.669 8.110 2.910 8.793 5.510 4.869 2.469

[92,] 6.128 3.648 3.648 5.128 2.448 2.834 1.234 0.155 1.955 -1.603 0.955 0.234 0.234

[93,] 2.603 4.531 7.331 3.203 2.331 2.779 5.779 2.307 3.307 1.362 1.107 6.379 5.979

[94,] 6.752 3.766 2.566 6.352 0.566 5.090 0.890 -0.497 4.503 -0.069 5.303 0.490 0.290

[95,] 5.503 7.331 1.731 2.303 3.131 0.979 4.179 0.007 -0.593 -1.138 1.807 0.979 2.779

[96,] 6.286 8.276 2.676 7.086 6.676 2.683 3.483 1.272 1.272 2.052 7.672 4.283 5.283

[97,] 6.155 2.297 0.497 8.555 -0.503 7.669 -0.331 0.210 5.210 0.293 9.410 2.069 0.469

[98,] 5.090 2.807 1.807 3.090 3.207 8.262 4.462 9.379 5.779 7.414 4.779 2.462 1.462

[99,] 4.976 3.883 4.483 8.176 1.483 6.145 4.945 0.052 5.052 -1.534 7.652 8.145 7.545

[100,] 6.552 7.366 4.566 10.952 9.566 3.290 3.290 1.503 2.503 1.931 9.703 7.690 8.090De los niveles de los atributos (11)

Finalizamos este recorrdido con las utilidades de cada uno de los niveles de los atributos señalados.

Utilidades de los niveles de los atributos:

uslall <- caUtilities(tprefm,tprof,tlevn)

Call:

lm(formula = frml)

Residuals:

Min 1Q Median 3Q Max

-5,1888 -2,3761 -0,7512 2,2128 7,5134

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 3,55336 0,09068 39,184 < 2e-16 ***

factor(x$price)1 0,24023 0,13245 1,814 0,070 .

factor(x$price)2 -0,14311 0,11485 -1,246 0,213

factor(x$variety)1 0,61489 0,11485 5,354 1,02e-07 ***

factor(x$variety)2 0,03489 0,11485 0,304 0,761

factor(x$kind)1 0,13689 0,11485 1,192 0,234

factor(x$kind)2 -0,88977 0,13245 -6,718 2,76e-11 ***

factor(x$aroma)1 0,41078 0,08492 4,837 1,48e-06 ***

---

Signif. codes: 0 '***' 0,001 '**' 0,01 '*' 0,05 '.' 0,1 ' ' 1

Residual standard error: 2,967 on 1292 degrees of freedom

Multiple R-squared: 0,09003, Adjusted R-squared: 0,0851

F-statistic: 18,26 on 7 and 1292 DF, p-value: < 2,2e-16print(uslall) [1] 3.55336207 0.24022989 -0.14311494 -0.09711494 0.61488506 0.03488506 -0.64977011 0.13688506 -0.88977011 0.75288506 0.41077586 -0.41077586Como ya fue indicado, una de las ventajas que nos ofrece el conjoint es la potencialidad de poder simular perfiles que no ha sido testados para ver como repartirían la cuota de mercado, siempre y cuando se consideraran elecciones transitivas y racionales (algo que sabemos que no siempre ocurre).

Perfiles a simular (BTL, Logit y Máxima Utilidad)

El siguiente código imprimirá los perfiles que deseamos simular y posteriormente el porcentaje de participación (cuota de mercado de cada perfil). Lo hacemos con cuatro formulaciones diferentes, BTL, Logit y Máxima Utilidad.

price variety kind aroma

1 3 2 2 2

2 1 3 1 1

3 2 3 3 2

4 3 1 2 1

5 1 1 1 1Y aqui las simulaciones …

TotalUtility MaxUtility BTLmodel LogitModel

1 2,19 8 15,15 11,80

2 3,69 14 21,28 21,08

3 3,10 18 24,02 29,38

4 3,59 23 17,01 11,16

5 4,96 37 22,54 26,58Resumen global (usando la función ‘Conjoint’)

Por último, ofrecemos la función global denominada Conjointque muestra resúmenes completos de la información testada.

Preferences of all respondents (preferences as rating data)

Call:

lm(formula = frml)

Residuals:

Min 1Q Median 3Q Max

-5,1888 -2,3761 -0,7512 2,2128 7,5134

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 3,55336 0,09068 39,184 < 2e-16 ***

factor(x$price)1 0,24023 0,13245 1,814 0,070 .

factor(x$price)2 -0,14311 0,11485 -1,246 0,213

factor(x$variety)1 0,61489 0,11485 5,354 1,02e-07 ***

factor(x$variety)2 0,03489 0,11485 0,304 0,761

factor(x$kind)1 0,13689 0,11485 1,192 0,234

factor(x$kind)2 -0,88977 0,13245 -6,718 2,76e-11 ***

factor(x$aroma)1 0,41078 0,08492 4,837 1,48e-06 ***

---

Signif. codes: 0 '***' 0,001 '**' 0,01 '*' 0,05 '.' 0,1 ' ' 1

Residual standard error: 2,967 on 1292 degrees of freedom

Multiple R-squared: 0,09003, Adjusted R-squared: 0,0851

F-statistic: 18,26 on 7 and 1292 DF, p-value: < 2,2e-16[1] "Part worths (utilities) of levels (model parameters for whole sample):"

levnms utls

1 intercept 3,5534

2 low 0,2402

3 medium -0,1431

4 high -0,0971

5 black 0,6149

6 green 0,0349

7 red -0,6498

8 bags 0,1369

9 granulated -0,8898

10 leafy 0,7529

11 yes 0,4108

12 no -0,4108

[1] "Average importance of factors (attributes):"

[1] 24,76 32,22 27,15 15,88

[1] Sum of average importance: 100,01

[1] "Chart of average factors importance"Preferences of first respondent (preferences as default - rating data):

Call:

lm(formula = frml)

Residuals:

1 2 3 4 5 6 7 8 9 10 11 12 13

1,1345 -1,4897 0,3103 -0,2655 0,3103 0,1931 1,5931 -1,4310 -1,4310 1,1207 0,3690 1,1931 -1,6069

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 3,3937 0,5439 6,240 0,00155 **

factor(x$price)1 -1,5172 0,7944 -1,910 0,11440

factor(x$price)2 -1,1414 0,6889 -1,657 0,15844

factor(x$variety)1 -0,4747 0,6889 -0,689 0,52141

factor(x$variety)2 -0,6747 0,6889 -0,979 0,37234

factor(x$kind)1 0,6586 0,6889 0,956 0,38293

factor(x$kind)2 -1,5172 0,7944 -1,910 0,11440

factor(x$aroma)1 0,6293 0,5093 1,236 0,27150

---

Signif. codes: 0 '***' 0,001 '**' 0,01 '*' 0,05 '.' 0,1 ' ' 1

Residual standard error: 1,78 on 5 degrees of freedom

Multiple R-squared: 0,8184, Adjusted R-squared: 0,5642

F-statistic: 3,22 on 7 and 5 DF, p-value: 0,1082[1] "Part worths (utilities) of levels (model parameters for whole sample):"

levnms utls

1 intercept 3,3937

2 low -1,5172

3 medium -1,1414

4 high 2,6586

5 black -0,4747

6 green -0,6747

7 red 1,1494

8 bags 0,6586

9 granulated -1,5172

10 leafy 0,8586

11 yes 0,6293

12 no -0,6293

[1] "Average importance of factors (attributes):"

[1] 43,34 18,93 24,66 13,06

[1] Sum of average importance: 99,99

[1] "Chart of average factors importance"Preferences of group of 5 respondents (preferences as rating data):

Call:

lm(formula = frml)

Residuals:

Min 1Q Median 3Q Max

-4,7566 -2,5103 0,3234 2,3697 5,4897

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 4,91552 0,41976 11,710 <2e-16 ***

factor(x$price)1 0,19080 0,61309 0,311 0,757

factor(x$price)2 -0,09540 0,53163 -0,179 0,858

factor(x$variety)1 -0,45540 0,53163 -0,857 0,395

factor(x$variety)2 0,66460 0,53163 1,250 0,216

factor(x$kind)1 0,06460 0,53163 0,122 0,904

factor(x$kind)2 -1,00920 0,61309 -1,646 0,105

factor(x$aroma)1 -0,08103 0,39308 -0,206 0,837

---

Signif. codes: 0 '***' 0,001 '**' 0,01 '*' 0,05 '.' 0,1 ' ' 1

Residual standard error: 3,071 on 57 degrees of freedom

Multiple R-squared: 0,09089, Adjusted R-squared: -0,02076

F-statistic: 0,8141 on 7 and 57 DF, p-value: 0,5794[1] "Part worths (utilities) of levels (model parameters for whole sample):"

levnms utls

1 intercept 4,9155

2 low 0,1908

3 medium -0,0954

4 high -0,0954

5 black -0,4554

6 green 0,6646

7 red -0,2092

8 bags 0,0646

9 granulated -1,0092

10 leafy 0,9446

11 yes -0,081

12 no 0,081

[1] "Average importance of factors (attributes):"

[1] 42,13 22,48 22,34 13,05

[1] Sum of average importance: 100

[1] "Chart of average factors importance"Por último, una cuestión relevante sería segmentar nuestro mercado. ¿Es igual el comportamiento de todos los perfiles de individuo con respecto a la importancia y la utilidad de factores y niveles? La respuesta a esta cuestión la tendremos en el análisis cluster, y eso es lo que vamos a hacer.

Segmentación

Cluster de respondentes

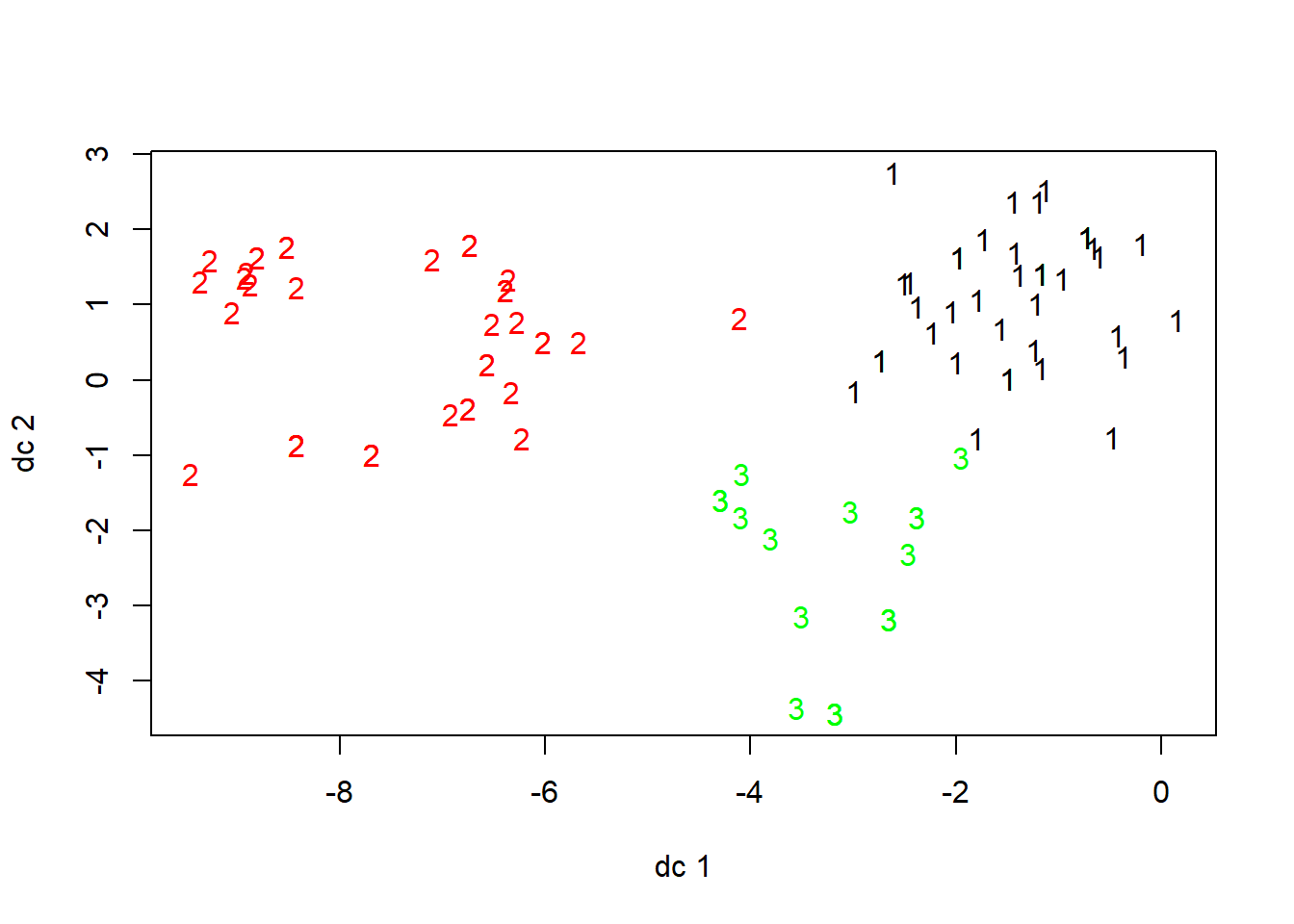

La función caSegmentation, divide a nuestra muestra en n clusters usando el método k-means del paquete estándar stats. Como resultado obtendremos un mapa de individuos y un vector con la pertenencia a cada grupo del individuo.

Length Class Mode

segm 9 kmeans list

util 1300 -none- numeric

sclu 100 -none- numericK-means clustering with 3 clusters of sizes 40, 40, 20

Cluster means:

[,1] [,2] [,3] [,4] [,5] [,6] [,7] [,8] [,9] [,10] [,11] [,12] [,13]

1 5.480275 2.9381 1.3681 4.540275 1.9731 3.782900 1.382900 0.965750 2.820750 0.111225 3.450750 0.442900 0.692900

2 4.754975 4.6918 3.6718 6.964975 6.6918 3.500525 4.385525 2.717225 3.062225 1.840925 6.292225 6.595525 7.105525

3 2.623500 6.6211 4.7511 2.933500 2.5211 4.189050 4.549050 5.066950 2.086950 5.312100 4.266950 4.859050 3.569050

Clustering vector:

[1] 2 3 2 2 2 1 2 3 2 2 2 2 1 1 1 1 3 1 3 1 1 2 1 2 3 2 3 3 2 2 1 2 3 2 2 2 2 1 1 1 1 3 1 3 1 2 2 1 1 1 2 1 1 1 2 2 1 2 1 3 1 1 2 3 3 2 1 1 1 2 2 1 2 3 2 2 2 1 2 2 3 3 2 2 1 1 1 1 3 1 3 1 3 1 1 2 1 3 2 2

Within cluster sum of squares by cluster:

[1] 1605.654 2690.267 1131.293

(between_SS / total_SS = 41.4 %)

Available components:

[1] "cluster" "centers" "totss" "withinss" "tot.withinss" "betweenss" "size" "iter" "ifault"

Referencias

- Bak A. and Bartlomowicz T. (2012), Conjoint analysis method and its implementation in conjoint R package.

- Pociecha J., Decker R. (Eds.), Data analysis methods and its applications, C.H. Beck, p. 239-248.